Détecteurs de mensonges, gardes-frontières gérés par intelligence artificielle, demandes d’asile traitées par les algorithmes… de plus en plus d’outils numériques sont développés par les États pour contrôler les frontières. Au détriment des droits des personnes exilées. Tour d’horizon de certains outils utilisés aux États-Unis, au Royaume-Uni et dans plusieurs pays de l’Union européenne.

Un mur virtuel érigé contre les personnes exilées ? C’est bien ce à quoi nous pourrions être en train d’assister. Lorsque des États en viennent par exemple à utiliser la reconnaissance des émotions grâce à l’intelligence artificielle pour plus de contrôles aux frontières, il y a dérive. La course effrénée aux nouvelles technologies a ses limites. Nous n’accepterons pas des technologies qui vont à l’encontre des droits humains.

Voici un aperçu de cinq outils numériques utilisés aux frontières par des pays de l’Union européenne, les États-Unis et le Royaume-Unis. Nos équipes d’Amnesty Tech les ont recensés.

1. Détecteurs de mensonges, reconnaissance faciale et d’émotions aux frontières de l’Europe

Un détecteur de mensonge fonctionnant à l’intelligence artificielle pour contrôler les frontières… Ce dispositif inquiétant est financé par l’Union européenne. Baptisé iBorderCtrl, le projet a été testé en Hongrie, en Grèce et en Lettonie. L’idée : remplacer les gardes-frontières par des logiciels pour réaliser un « premier filtre ». Le fonctionnement : lorsqu’une personne exilée franchit une frontière, elle est soumise à un interrogatoire virtuel qui fonctionne par détecteur de mensonges. L’algorithme a été développé de façon à évaluer les moindres détails des expressions via la reconnaissance faciale : fréquence des clignements des yeux, direction du regard, changements dans le ton de la voix, tout est passé au crible. L’objectif : discerner les déclarations considérées comme mensongères. Le garde-frontière virtuel pose des questions à la personne exilée comme son nom, son pays d’origine, le motif de son voyage, etc. Si le système estime que la personne a répondu honnêtement aux questions, elle reçoit un code lui permettant de franchir la frontière. Si la personne a «échouée », elle est réorientée vers des gardes-frontières « physiques » et sera soumise à un interrogatoire bien plus poussé.

L’outil utilisé : les technologies de reconnaissance faciale et émotionnelle. Ce type d’exemple qui semble tout droit sorti d’une fiction montre les dérives de l’utilisation de la reconnaissance faciale.

Personnes réfugiées à l’intérieur du centre d’accueil et d’identification de Malakasa en Grèce, 24 juin 2023 / © George Schinas - NurPhoto via AFP

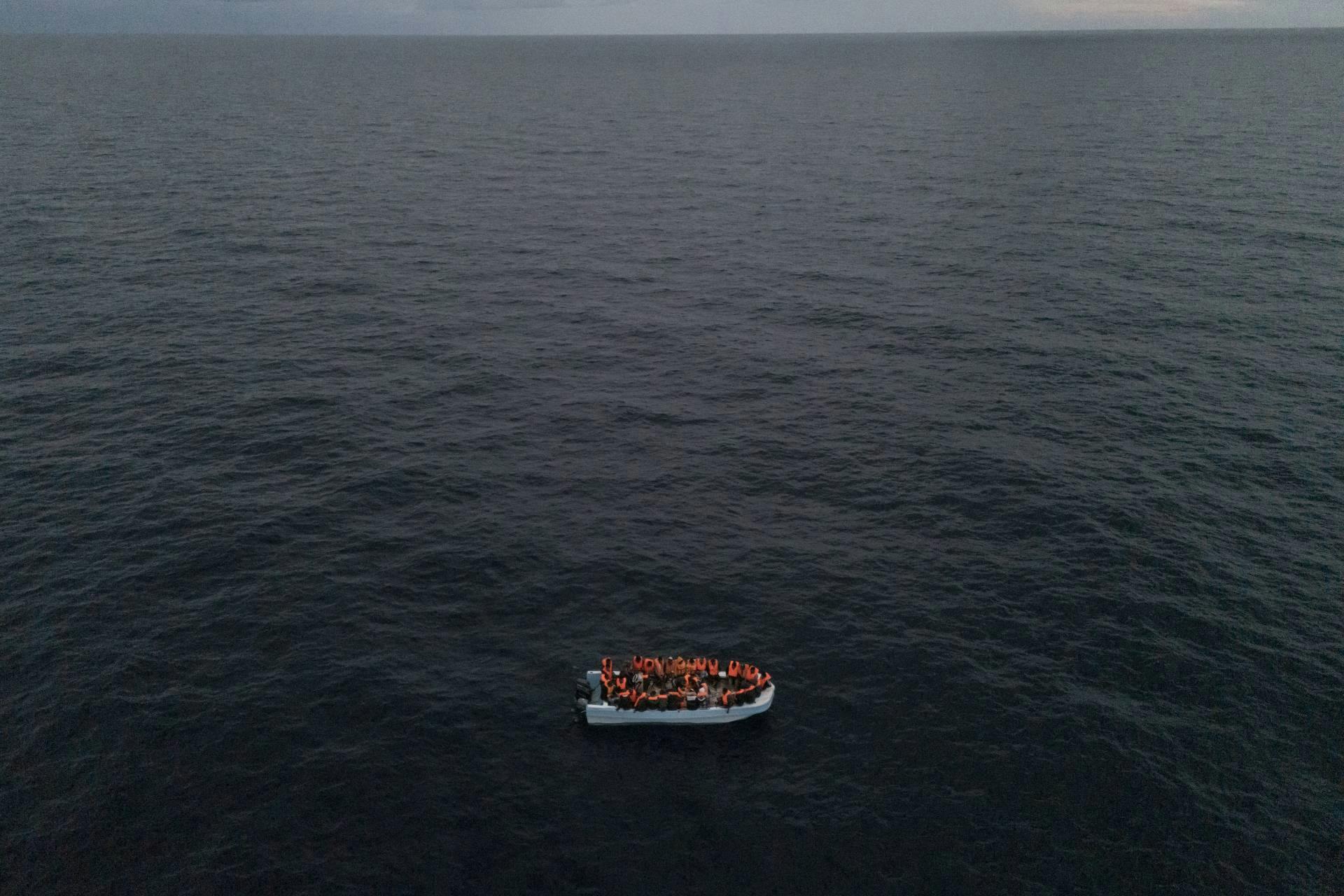

2. Des drones au-dessus de la Méditerranée pour empêcher les bateaux d’atteindre les côtes

L’Union européenne déploie une surveillance aérienne en temps réel ainsi que des drones au-dessus de la Méditerranée. C’est l’Italie et Frontex, l'Agence européenne de garde-frontières et de garde-côtes, qui utilisent ces technologies. Lorsqu’un bateau est identifié par les drones, la position est signalée aux autorités libyennes, déclenchant ainsi leur intervention. L’UE permet donc aux garde-côtes libyens d'intercepter les bateaux et de ramener les personnes exilées en Libye. Nous viennent alors en tête les images atroces des centres de détention de personnes exilées en Libye où elles vivent un cauchemar : torture, violences sexuelles, travail forcé, vente d’êtres humains. C’est insoutenable. L’Union européenne se rend complice de ces atrocités. Au lieu d’y mettre fin, l’Europe aide la Libye à piéger ces personnes dans l’enfer.

55 personnes exilées sont sauvées en mer Méditerranée par un navire de l'ONG Open Arms décembre 2023 / © Brais Lorenzo - Anadolu via AFP

3. Une application rendue obligatoire pour demander l’asile aux États-Unis

Depuis mai 2023, demander l’asile aux États-Unis repose en grande partie sur une application : CBP One. Elle est le nouveau passage obligé pour les personnes demandant l’asile aux États-Unis. Elle est aussi et surtout devenue leur pire cauchemar. Ses défenseurs vous répondront qu’elle permet d’automatiser l’ensemble des demandes d’asile déposées. Écran de fumée. L’application présente de nombreuses failles : blocages fréquents, problèmes d’accessibilité dus à la langues, obstacles à l’alphabétisation, besoin d’une connexion Internet pour l’enregistrement, etc. Et c’est sans compter les innombrables obstacles auxquels les personnes exilées doivent faire face lors de leur périple migratoire. En arrivant aux frontières des États-Unis, certaines personnes trouvent refuge dans des zones sans électricité, les téléphones portables y peuvent être endommagés, perdus, volés. Et pourtant, la seule solution pour demander l’asile : l’application CBP One.

Une personne exilée dans le campement de Ciudad Juarez à la frontière entre le Mexique et les États-Unis, montre montre l’application « CBP One », mai 2023 / © Gilles CLARENNE via AFP

Rendre obligatoire l’utilisation de l’application CBP One aux personnes exilées arrivant à la frontière des États-Unis risque de violer le principe de non-refoulement, qui interdit aux pays de renvoyer des réfugiés dans des pays où ils risquent de mauvais traitements, comme certaines régions du Mexique.

Autre point : la reconnaissance faciale, utilisée dans CBP One. Lorsque les demandeurs d’asile se connectent à l’application, ils doivent soumettre des données personnelles, comme une photographie qui permettra par la suite d’enrichir les bases de données nourrissant les algorithmes de reconnaissance faciale. Ce qui pose de sérieuses questions en termes de respect du droit à la vie privée. Ces technologies de reconnaissance faciale comportent en plus des risques de discriminations.

En quoi les technologies risquent d’amplifier les discriminations ?

« La prolifération des technologies spécifiques aux systèmes d’asile et d’immigration risque de perpétuer et de renforcer la discrimination, le racisme et la surveillance disproportionnée à l’encontre des personnes racisées. » explique Matt Mahmdoui, notre chercheur à Amnesty Tech, spécialisé sur les questions des nouvelles technologies. Des outils comme la reconnaissance faciale, entraînées par des personnes réelles, comportent de fait, de forts biais discriminatoires, qui peuvent conduire à des erreurs.

4. Aux États-Unis, des miradors aux frontières gérés par l’intelligence artificielle

Donald Trump avait fait de la construction d’un mur sur la frontière entre le Mexique et les États-Unis une promesse électorale. À la place, il pourrait bien y avoir un mur virtuel… Aux États-Unis, le gouvernement déploie des infrastructures de surveillance « intelligentes » comme des miradors gérés par intelligence artificielle le long de la frontière avec le Mexique. De tels dispositifs augmentent le risque de profilage des personnes noires ou latino-américaines.

De plus en plus d'éléments indiquent que l'utilisation de la technologie pour surveiller, suivre et intercepter des personnes exilées au cours de leur périple migratoire peut entraîner la mort de certaines personnes qui empruntent des itinéraires plus périlleux pour échapper à la surveillance.

5. Au Royaume-Uni, des bracelets électroniques pour les personnes exilées menacées d’expulsion

Au Royaume-Uni, toutes les personnes exilées menacées d’expulsion sont équipées, obligatoirement, de bracelets électroniques à la cheville. Une surveillance en permanence. Le Royaume-Uni a introduit le marquage électronique obligatoire en 2016. La mesure a été étendue aux personnes placées en liberté sous caution en 2021. Les autorités britanniques peuvent recourir à la reconnaissance faciale via des montres intelligentes, selon une enquête du Guardian. Concrètement, des personnes exilées reconnues coupables d'une infraction peuvent se voir proposer cette montre. Elles devront alors scanner leur visage jusqu’à cinq fois par jour. L’objectif : les traquer.

En septembre 2022, près de 15 000 personnes avaient été placées sous surveillance électronique au Royaume-Uni, élargissant ainsi un système qui met en péril les droits humains, comme les droits à la dignité et au respect de la vie privée.

Les technologies de surveillance séduisent de plus en plus d’entreprises privées et de gouvernements. Les exemples mentionnés ici en sont une triste illustration. Les personnes exilées, dont les droits sont déjà extrêmement fragilisés, ne peuvent servir de cobaye à l’utilisation toujours plus pernicieuse de ces outils technologiques qui mettent en danger nos droits. Parmi nos demandes : interdire les outils technologiques qui menacent le droit d’asile et interdire, strictement, la reconnaissance faciale.

Contre la reconnaissance faciale en France

Expérimentations de la reconnaissance faciale dans plusieurs villes, vidéosurveillance algorithmique légalisée par la loi JO 2024... En France, la surveillance gagne du terrain.

Agissons dès maintenant, signez notre pétition.