Les grandes puissances exportatrices d’armes, convaincues que le robot tueur est l’arme de demain, balaient les objections des ONG, dont Amnesty. La France ne fait pas exception.

L e 9 avril 2013, Christof Heyns, rapporteur spécial des Nations unies sur les exécutions extrajudiciaires, sommaires ou arbitraires, rend public son rapport annuel, qui porte cette année-là sur « les robots létaux autonomes (RLA) et la protection de la vie ».

Il observe, dans ses conclusions, que « des machines de guerre infatigables, prêtes à être déployées à la simple pression d’un bouton » présentent notamment « le danger d’un conflit armé permanent ». Par conséquent, il incombe à ceux qui voudraient « déployer des RLA de démontrer pourquoi il faudrait autoriser l’utilisation spécifique de ces armes dans des circonstances particulières ».

Compte-tenu des implications énormes que cela aurait pour la protection de la vie, des preuves considérables devraient être apportées.

Christof Heyns, rapporteur spécial des Nations unies

Puis le rapporteur demande aux États membres de l’ONU de « décréter un moratoire national sur les RLA », et de « s’engager à être aussi transparents que possible au sujet de leurs activités internes d’examen relatif aux armes, notamment sur les paramètres de mesure utilisés pour tester les systèmes robotisés ».

Lire aussi : Robots tueurs, play it now

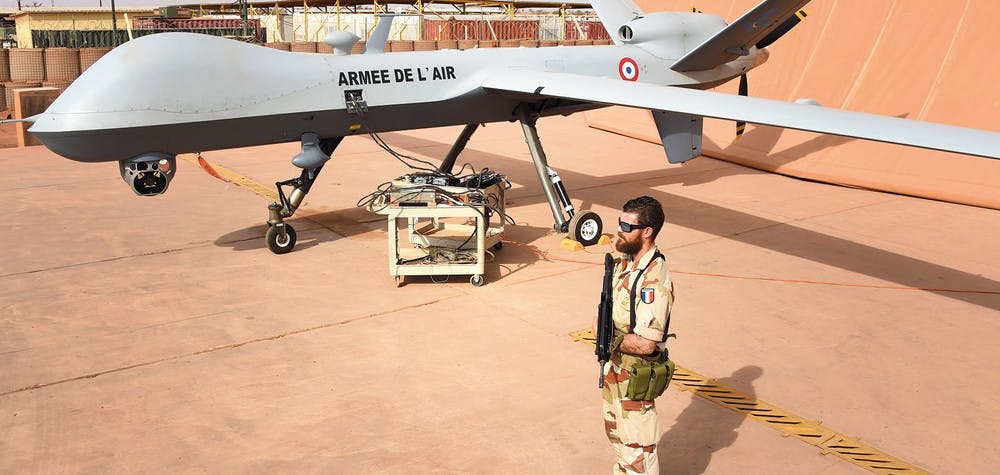

Le 30 mai suivant, la France « remercie M. Heyns pour son rapport », et lui répond qu’ « elle ne possède pas et ne prévoit pas de se doter de systèmes d’armes robotisés à capacité d’ouverture de feu autonome », car elle tient à préserver la « pleine responsabilité des dirigeants politiques et des chefs militaires dans la décision de recours à la force armée », et « estime que le rôle de l’être humain dans la décision d’ouvrir le feu doit être préservé ».

Deux mois plus tard, le 25 juillet 2013, le ministre français de la Défense, le socialiste Jean-Yves Le Drian, fait à une sénatrice d’opposition qui lui a posé une question sur la doctrine française en matière de robots tueurs une réponse en tout point similaire : « les forces armées françaises ne possèdent pas et ne prévoient pas de se doter de systèmes d’armes robotisés à capacité d’ouverture de feu autonome ».

Lire aussi : 10 raisons pour lesquelles il faut interdire les «robots tueurs»

Tony Fortin, de l’Observatoire des armements accuse la France de « jouer un double jeu ». Elle tient un discours officiel qui se veut rassurant, où « l’homme gardera en dernier recours la maîtrise des machines » engagées sur les champs de bataille du futur.

Mais en regardant de plus près, la position française, telle qu’elle s’exprime par exemple aux Nations unies, on s’aperçoit que cette intervention humaine se résumera finalement à programmer des missions que des robots effectueront seuls. Pire : alors même qu’il assure s’opposer aux robots tueurs, le gouvernement français est, de fait, engagé depuis plusieurs années déjà dans leur conception.

Du programme de numérisation Scorpion, lancé en 2005, qui permettra notamment, en 2025, de connecter entre eux les équipements automatisés de l’armée de terre au projet de drone de combat furtif franco-britannique Scaf, qui sera, explique Tony Fortin, « doté d’une intelligence artificielle lui permettant le cas échéant de prendre seul la décision d’ouvrir le feu après évaluation du contexte », et dont le financement n’a fait l’objet d’aucun débat public : « la France est en train de réorienter l’essentiel de son armement – et de sa doctrine militaire – vers l’“autonomie fonctionnelle“ complète pour laquelle certains militaires de haut rang militent ouvertement – cependant que d’autres se montrent plus circonspects. Il revient dès lors à la société civile de se mobiliser – avant que le cauchemar absolu où des ordinateurs décideraient seuls de la vie et de la mort d’êtres humains ne soit devenu réalité ».

- Sébastien Fontenelle pour La Chronique d'Amnesty International